Dismiss

Innovación

Una plataforma construida para la IA

Unificado, automatizado y listo para convertir los datos en inteligencia.

Dismiss

16-18 juni, Las Vegas

Pure//Accelerate® 2026

Ontdek hoe u de ware waarde van uw gegevens kunt ontsluiten.

Computación paralela frente a computación distribuida: Una descripción general

La computación paralela y distribuida son fundamentales para la computación moderna de alto rendimiento (HPC), el análisis de datos y la inteligencia artificial (AI). Aunque están relacionados, son enfoques distintos con diferentes arquitecturas, ventajas y demandas de almacenamiento.

En este artículo, exploraremos las diferencias fundamentales entre la computación paralela y la distribuida, y cómo Everpure respalda tanto con soluciones de almacenamiento innovadoras como FlashBlade® de Everpure y el miembro más reciente de la familia FlashBlade, FlashBlade//EXA™.

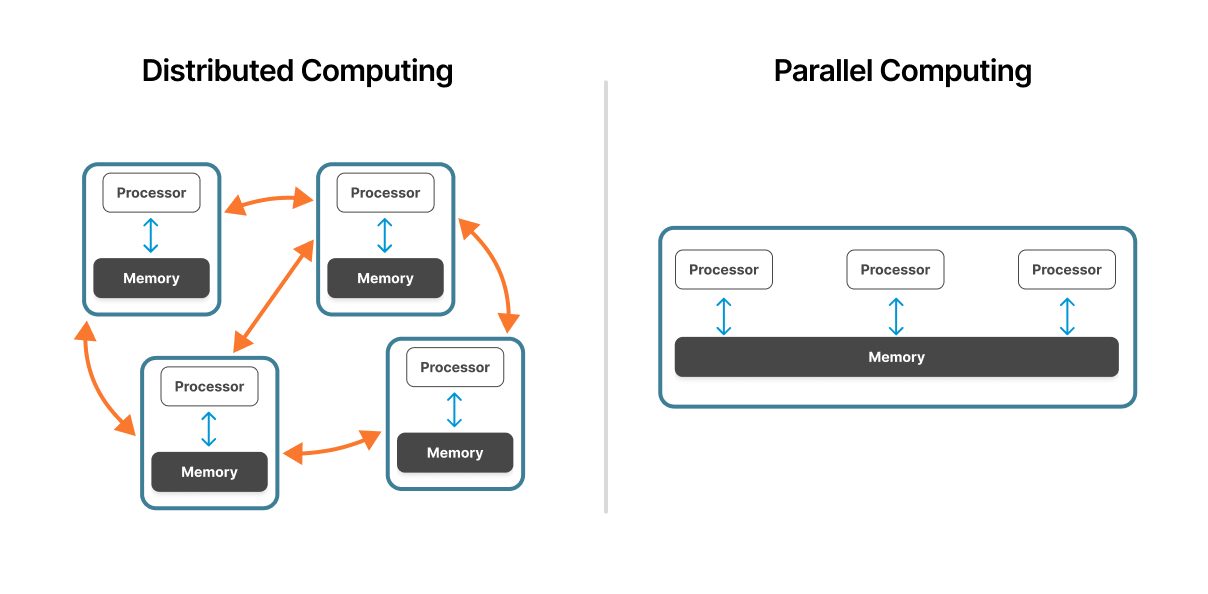

Figura 1: Un sistema informático distribuido en comparación con un sistema informático paralelo.

Fuente: ResearchGate

¿Qué es la computación paralela?

La computación paralela implica dividir una tarea en subtareas más pequeñas que se procesan simultáneamente en varios procesadores o núcleos dentro de un solo sistema.

Entre los ejemplos tradicionales se incluyen los siguientes:

- Modelado climático

- Encuesta sísmica

- Astrofísica computacional

En los últimos años, la computación en paralelo ha evolucionado más allá del procesamiento multinúcleo basado en CPU en modelos acelerados por GPU. Las cargas de trabajo de AI/ML modernas ahora dependen en gran medida de arquitecturas de GPU masivamente paralelas, como NVIDIA A100 o H100, que permiten el aprendizaje profundo, el procesamiento de lenguaje natural y la visión de computación a escala.

La computación en paralelo también es el núcleo de innovaciones como la computación cuántica y los sistemas neuromórficos, que emulan las arquitecturas neuronales para procesar los datos de manera más eficiente. Incluso los dispositivos móviles y periféricos ahora incorporan capacidades de procesamiento en paralelo para admitir la AI en tiempo real en el edge.

¿Qué es la computación distribuida?

La computación distribuida distribuye tareas en varias máquinas, a menudo en diferentes ubicaciones físicas, conectadas en red para funcionar como un solo sistema. Cada nodo maneja una parte de la carga de trabajo y comunica los resultados a un sistema central.

Entre los ejemplos se incluyen los siguientes:

- MapReduce y plataformas de big data como Apache Hadoop y Spark

- Representación distribuida en animación/VFX

- Simulaciones de varios agentes en diseño aeroespacial y automotriz

Las arquitecturas distribuidas son comunes en la computación en la nube, los entornos periféricos y los sistemas de IoT a gran escala, donde la escalabilidad y la distribución geográfica son esenciales.

Las líneas entre la computación paralela y la distribuida están cada vez más borrosas en las implementaciones modernas de HPC e AI, donde las arquitecturas desglosadas aprovechan ambos enfoques simultáneamente. Esta convergencia impulsa la demanda de plataformas de almacenamiento que admitan ancho de banda alto, latencia baja y simultaneidad masiva.

Paralelo frente a distribuido: Diferencias clave

Si bien ambos enfoques desglosan problemas complejos en tareas más pequeñas, difieren fundamentalmente en arquitectura e implementación.

Arquitectura del sistema

La computación paralela funciona dentro de una sola máquina o clúster estrechamente acoplado. Varios procesadores comparten el acceso al mismo hardware físico con la arquitectura de memoria unificada, lo que permite una comunicación rápida entre las unidades de procesamiento.

La computación distribuida abarca varias computadoras independientes conectadas a través de la red. Cada nodo funciona de forma autónoma con su propio procesador, memoria y sistema operativo, y se coordina a través de protocolos de red.

Organización de memoria

En sistemas paralelos, los procesadores comparten un espacio de memoria común. Esta arquitectura de memoria compartida permite el intercambio rápido de datos: los procesadores leen y escriben en las mismas ubicaciones de memoria. Sin embargo, este recurso compartido puede convertirse en un cuello de botella a medida que aumenta el recuento de procesadores.

Los sistemas distribuidos usan memoria independiente en cada nodo. Los nodos se comunican al pasar mensajes que contienen los datos necesarios. Este modelo de memoria distribuida elimina la contención de la memoria, pero introduce la sobrecarga de comunicación de red.

Métodos de comunicación

La computación paralela depende de buses internos de alta velocidad o interconexiones. La comunicación ocurre a la velocidad de la memoria: nanosegundos para transferencias de caché a caché, microsegundos para el acceso a la memoria principal. Esta baja latencia hace que los sistemas paralelos sean ideales para problemas estrechamente vinculados que requieren coordinación frecuente.

Los sistemas distribuidos se comunican a través de protocolos de red. La comunicación de red introduce latencia, generalmente medida en milisegundos, dependiendo de la distancia geográfica. Esto significa que los sistemas distribuidos funcionan mejor para los problemas con acoplamiento suelto en los que las tareas funcionan de forma independiente.

Escalabilidad

La computación paralela escala verticalmente, agregando más procesadores a un solo sistema. Este enfoque alcanza los límites físicos: limitaciones del ancho de banda de la memoria, limitaciones térmicas y contención del bus. La mayoría de los sistemas paralelos se escalan a cientos de núcleos.

La computación distribuida escala horizontalmente, lo que agrega más máquinas a la red. Los sistemas pueden crecer de un puñado de nodos a miles de máquinas. Las plataformas en la nube operan de forma rutinaria sistemas distribuidos que abarcan centros de datos en todo el mundo.

Tolerancia a fallas

Los sistemas paralelos generalmente representan un único punto de falla. Si la máquina falla, todo el cálculo se detiene.

Los sistemas distribuidos ofrecen tolerancia a fallas inherentes. Cuando un nodo falla, otros nodos continúan procesándose. Los sistemas distribuidos bien diseñados detectan fallas, reasignan el trabajo y mantienen la operación a medida que las máquinas individuales se desconectan.

Distribución geográfica

La computación paralela concentra el procesamiento en una sola ubicación. Todos los procesadores residen en el mismo centro de datos, conectado por la infraestructura local.

La computación distribuida permite la distribución geográfica. Los nodos pueden operar en diferentes ciudades o continentes, lo que admite casos de uso como redes de entrega de contenido y el cumplimiento de las reglamentaciones de residencia de datos.

Las líneas entre la computación paralela y la distribuida están cada vez más borrosas en las implementaciones modernas de HPC e AI , donde las arquitecturas desglosadas aprovechan ambos enfoques simultáneamente.

Aplicaciones modernas de computación paralela

Más allá de la computación científica tradicional, el paralelismo impulsa muchas cargas de trabajo de vanguardia:

- AI y aprendizaje automático: Entrenar modelos grandes usando el paralelismo de datos entre clústeres de GPU

- Análisis en tiempo real: Detección de fraude, conducción autónoma y motores de recomendación en vivo

- Operaciones de alta frecuencia: Procesamiento de transacciones de latencia ultrabaja

- Minería de criptomonedas: Validación eficiente de hash y consenso

- Aeroespacial y energía: Simulaciones multifísicas y modelado predictivo

Everpure admite estas industrias con plataformas de datos capaces de mantener el ancho de banda de varios terabytes por segundo en clústeres de procesamiento altamente paralelos.

Modelos híbridos y tendencias de convergencia

Las cargas de trabajo modernas utilizan cada vez más modelos híbridos que combinan la computación paralela y distribuida, por ejemplo, un marco de trabajo de entrenamiento distribuido como Horovod o PyTorch Lightning que se ejecuta en un clúster de GPU utilizando métodos paralelos a los datos.

FlashBlade y el miembro más reciente de la familia FlashBlade, FlashBlade//EXA, son especialmente adecuados para estos entornos. Con soporte para cargas de trabajo mixtas simultáneas, acceso multiprotocolo (NFS, S3) y escalabilidad elástica, eliminan la necesidad de reestructurar los sistemas de almacenamiento para cada paradigma informático.

El rol del almacenamiento en la computación paralela y distribuida

No importa cuán potentes sean sus procesadores, solo son tan efectivos como los procesos de datos que los alimentan. Los cuellos de botella en el almacenamiento suelen ser el factor limitante tanto en entornos paralelos como distribuidos.

FlashBlade y el miembro más reciente de la familia FlashBlade, FlashBlade//EXA, están diseñados para superar estas limitaciones con:

- Rendimiento de alta productividad y latencia ultrabaja

- Paralelismo masivo entre miles de clientes simultáneos

- Almacenamiento de objetos y archivos con escalabilidad horizontal diseñado para AI, análisis y HPC

Estas plataformas admiten el paralelismo de memoria compartida (para granjas de GPU y procesadores tensores) y el acceso a archivos distribuidos (para AI/ML a gran escala, genómica y flujos de trabajo de simulación).

Conclusiones

Comprender las diferencias entre la computación paralela y la distribuida es esencial para diseñar una infraestructura de datos moderna. La computación paralela ofrece el máximo rendimiento para cargas de trabajo estrechamente acopladas que requieren una comunicación de latencia ultrabaja dentro de un solo sistema. La computación distribuida proporciona escalabilidad ilimitada y tolerancia a fallas para problemas de acoplamiento suelto que abarcan varias máquinas o regiones geográficas.

La elección entre estos enfoques depende de sus requisitos específicos. Cuando las tareas necesitan coordinación frecuente y tiempos de respuesta de submilisegundos, las arquitecturas paralelas sobresalen. Cuando las aplicaciones deben escalar horizontalmente, tolerar las fallas con gracia o procesar datos en ubicaciones distribuidas, los sistemas distribuidos son la respuesta. Muchas cargas de trabajo modernas aprovechan ambas, utilizando clústeres de GPU paralelos dentro de infraestructuras de nube distribuida.

El rendimiento del almacenamiento determina si su infraestructura de computación alcanza su potencial. No importa cuán potentes sean sus procesadores, solo son tan eficaces como los procesos de datos que los alimentan. FlashBlade y FlashBlade//EXA eliminan los cuellos de botella del almacenamiento con un rendimiento de alta productividad y latencia ultrabaja diseñado para arquitecturas paralelas y distribuidas. Admiten la simultaneidad masiva, las cargas de trabajo mixtas y la escalabilidad elástica que exigen los análisis de datos, la AI y la HPC modernos.

¿Está listo para eliminar los cuellos de botella del almacenamiento? Explore las soluciones de FlashBlade o comuníquese con Everpure para analizar su arquitectura informática específica.

Buscar recursos y eventos clave

FERIA COMERCIAL

Pure//Accelerate® 2026

June 16-18, 2026 | Resorts World Las Vegas

Prepárese para el evento más valioso al que asistirá este año.

DEMOSTRACIONES DE PURE360

Explore, aprenda y experimente Everpure.

Acceda a videos y demostraciones según demanda para ver lo que Everpure puede hacer.

VIDEO

Vea: El valor de una Enterprise Data Cloud.

Charlie Giancarlo explica por qué la administración de datos, no el almacenamiento, es el futuro. Descubra cómo un enfoque unificado transforma las operaciones de TI de una empresa.

RECURSO

El almacenamiento heredado no puede impulsar el futuro.

Las cargas de trabajo modernas exigen velocidad, seguridad y escalabilidad listas para la AI. ¿Su pila está lista?

Personalize for Me